O Que Você Precisa Saber Sobre Deepfakes: Usos, Riscos e o Futuro

Uma das tecnologias mais impressionantes e ao mesmo tempo preocupantes que, acompanham o avanço acelerado da inteligência artificial, são os deepfakes. Com os avanços do time da Microsoft (VASA-1), o futuro parece ainda mais perto.

Essas imagens, áudios e vídeos gerados por IA podem retratar pessoas reais dizendo e fazendo coisas que nunca aconteceram. O potencial criativo é imenso, mas também os riscos de manipulação e desinformação.

Neste artigo, vamos mergulhar a fundo neste tema para entender o que são deepfakes, como funcionam, seus usos positivos e negativos, como detectá-los e se proteger, assim como refletir sobre as implicações desta tecnologia para o futuro.

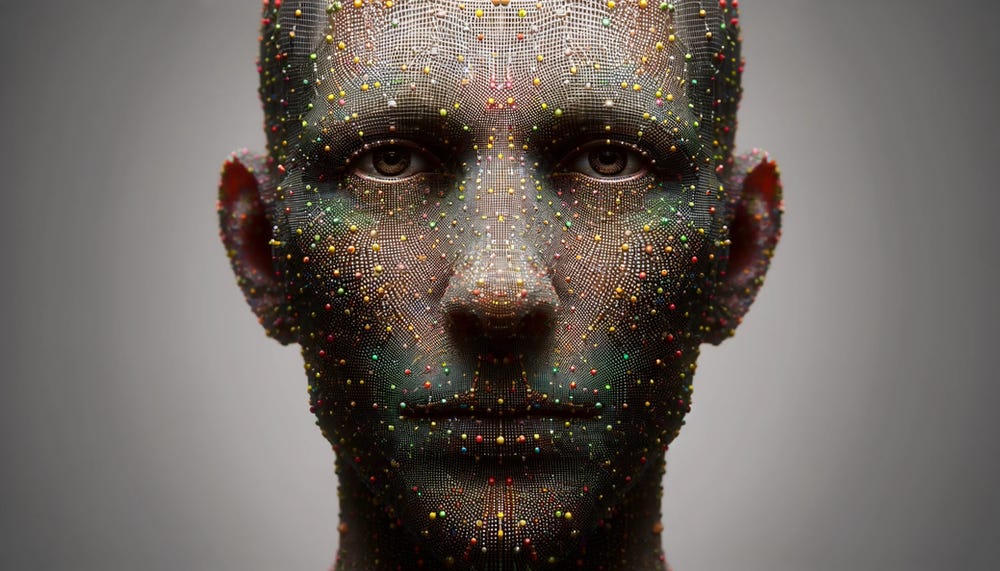

O Que São Deepfakes

Deepfakes são mídias digitais hiper-realistas onde o rosto ou a voz de uma pessoa é substituída pela de outra usando inteligência artificial. O resultado final pode ser um vídeo do Barack Obama xingando, um áudio da sua mãe pedindo dinheiro ou uma foto da sua ex-namorada em uma cena pornô.

O termo deepfake vem da junção de "deep learning" (aprendizado profundo) e "fake" (falso). Deep learning é a técnica de machine learning que usa redes neurais artificiais para reconhecer padrões complexos em grandes volumes de dados.

As redes neurais usadas nos deepfakes são treinadas com milhares ou milhões de imagens e áudios reais da pessoa-alvo. A partir desses exemplos, elas aprendem as características faciais, expressões, entonações e maneirismos em grande detalhe.

Então, por meio de um processo chamado Rede Adversária Generativa (Generative Adversarial Network ou GAN), duas redes neurais trabalham simultaneamente:

O Gerador tenta criar versões sintéticas cada vez mais realistas da pessoa.

O Discriminador tenta detectar se é uma mídia real ou falsa.

As duas redes competem e "evoluem" juntas a cada rodada, até que o Gerador consiga enganar o Discriminador consistentemente, chegando a um deepfake altamente verossímil.

Como Funcionam na Prática

Para trocar o rosto de alguém em um vídeo, as etapas básicas são:

Coletar um dataset com o máximo possível de imagens/vídeos de alta qualidade da pessoa-alvo. Podem ser obtidas de redes sociais, vídeos públicos, fotos vazadas, etc.

Treinar a IA geradora com esse dataset. Quanto mais dados e tempo de treinamento, mais preciso o modelo.

Fornecer o vídeo-alvo onde será feita a troca de rostos.

A IA faz o mapeamento e alinhamento dos pontos faciais chave (olhos, nariz, boca, queixo) quadro-a-quadro.

A face original é digitalmente substituída e mesclada com a face sintética, junto com ajustes de cor, iluminação e proporções.

O processo completo pode levar de algumas horas a alguns dias, dependendo da complexidade e duração. Mas já existem serviços e aplicativos que automatizam grande parte das etapas, permitindo que leigos criem deepfakes com poucos cliques.

Para áudio, o processo é similar. A partir de amostras de fala da pessoa-alvo, um modelo de IA aprende os fonemas, entonação e timbre da sua voz. Com um modelo bem treinado, é possível sintetizar novos áudios dizendo qualquer coisa com a voz clonada.

Aplicações Positivas dos Deepfakes

Antes de explorarmos o lado sombrio dos deepfakes, vamos ver alguns exemplos de como essa tecnologia pode ser usada para o bem:

Acessibilidade e Inclusão

Legendas automáticas: Gerar dublagens perfeitas em diversos idiomas a partir da transcrição, ampliando o acesso a conteúdos

Avatares de linguagem de sinais: Traduzir dinamicamente o áudio ou texto para um intérprete virtual de libras

Próteses de fala personalizadas: Restaurar a voz original de pessoas que sofreram acidentes ou tem distúrbios de fala

Educação e Treinamento

Aulas com professores virtuais: Permite entregar conteúdo personalizado e sob demanda, no idioma e didática ideal para cada aluno

Simulações de atendimento ao cliente: Gerar dezenas de avatares 3D para treinar equipes em diferentes perfis e situações

Recriação de personalidades históricas: Aprender história conversando com um deepfake interativo de Darwin ou Da Vinci

Entretenimento e Arte

Ressuscitar atores falecidos: Permitir que estrelas como Bruce Lee atuem em novos filmes, como fez a Lionsgate

Localização de games e filmes: Adaptar dinamicamente as falas e aparência dos personagens de acordo com a cultura local

Colaborações artísticas homem-máquina: Usar IA para gerar, performar e iterar junto com músicos, designers e pintores

Medicina e Saúde

Terapia com entes queridos: Recriar um avatar realista de um familiar falecido para ajudar no luto

Visualização de tratamentos: Mostrar uma prévia do resultado de cirurgias plásticas e ortodontia com a foto do próprio paciente

Treinamento médico personalizado: Gerar pacientes virtuais para simulações hiper-realistas e adaptadas ao nível de cada estudante

Usos Maliciosos dos Deepfakes

Infelizmente, assim como qualquer tecnologia poderosa, os deepfakes também podem ser usados para fins antiéticos, criminosos e destrutivos como:

Pornografia e Abuso

Pornografia não-consensual: De acordo com a empresa de cibersegurança Deeptrace, 96% dos vídeos deepfake na internet envolviam pornografia com rostos de celebridades femininas. Esse conteúdo é amplamente usado para chantagear, humilhar e assediar mulheres.

Pedofilia e exploração infantil: Deepfakes estão sendo usados por abusadores para criar material pedófilo realista sem diretamente explorar crianças reais.

Desinformação e Manipulação Política

Notícias falsas: Deepfakes de figuras públicas podem espalhar boatos, teorias conspiratórias e desinformação em escala massiva. Um estudo da Universidade de Oxford mostrou que durante as eleições americanas de 2020, 30% dos vídeos de campanha de todos os candidatos continham algum tipo de manipulação por IA.

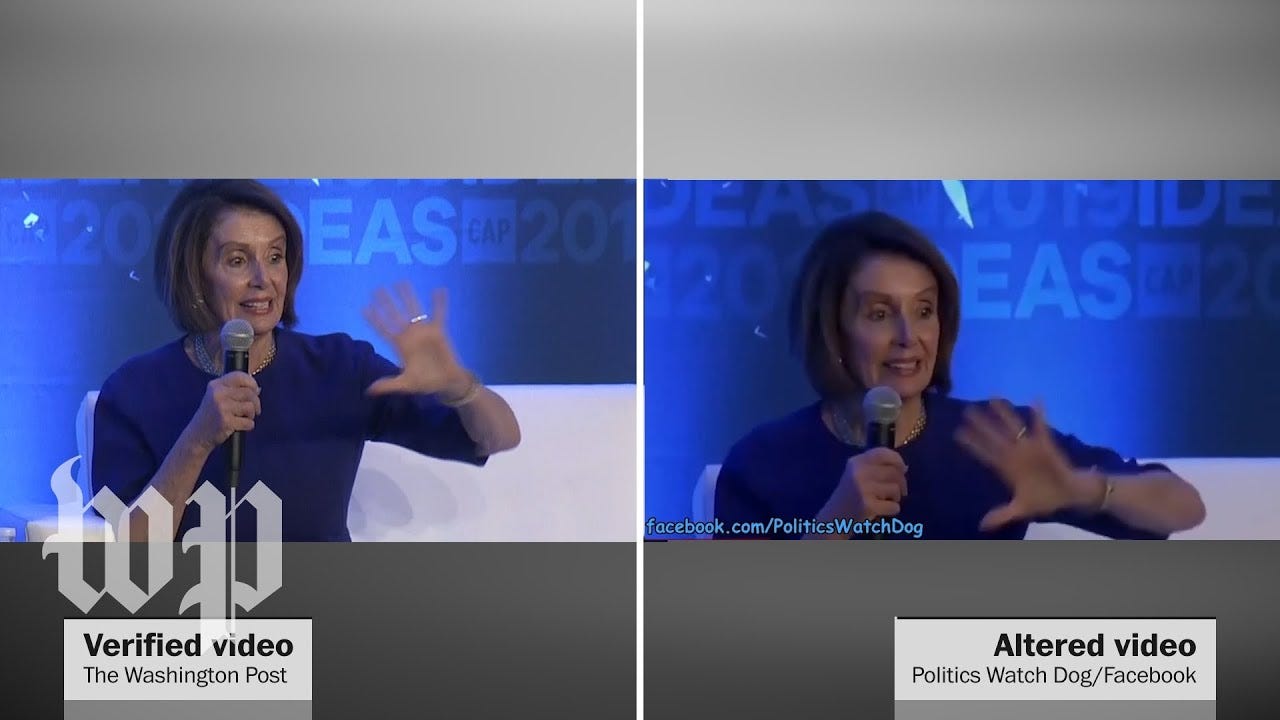

Sabotagem política: Um deepfake viral de um candidato dizendo algo ofensivo ou criminoso pode destruir sua reputação e chances de eleição. Em 2018, um vídeo ralentado da Nancy Pelosi dando a impressão que ela estava bêbada teve milhões de views.

Tensão internacional: Deepfakes falsos de líderes políticos declarando guerras ou prometendo ataques podem gerar conflitos e instabilidade entre países.

Golpes e Fraudes

Roubo de identidade: Deepfakes permitem que criminosos se passem com facilidade por outra pessoa para aplicar golpes, assumir contas bancárias e até vender imóveis.

Engenharia social: Um deepfake do seu chefe pedindo uma transferência bancária urgente ou do suporte técnico pedindo a senha do seu e-mail tem muito mais credibilidade e taxa de sucesso.

Manipulação de mercado: Um áudio deepfake de um CEO anunciando a falência da empresa pode causar um colapso imediato nas ações e pânico no mercado.

Chantagem e Extorsão

Ameaça de exposição: Com um deepfake comprometedor, político, empresários e pessoas comuns ficam vulneráveis a chantagens por dinheiro, favores ou informações.

Extorsão sexual: De posse de fotos sensuais, um golpista pode facilmente criar um deepfake pornô da vítima para extorquir dinheiro sob ameaça de enviar para família e amigos.

Como detectar Deepfakes

Com modelos de IA ficando cada vez mais sofisticados, detectar deepfakes está se tornando uma tarefa hercúlea. É uma corrida armamentista entre os falsificadores e os verificadores.

Já existem deepfakes considerados "indistinguíveis" do mundo real. E o mais assustador é que não é preciso ser um especialista em machine learning para criá-los. Hoje qualquer adolescente consegue gerar deepfakes altamente realistas com alguns cliques em aplicativos gratuitos como:

Reface (ex-Doublicat) - Troca rostos em fotos, GIFs e vídeos

Wombo - Anima fotos fazendo lip sync de músicas populares

MyHeritage - Anima fotos antigas de família

FaceApp - Altera a aparência com filtros de idade, gênero, sorriso, cabelo, maquiagem, etc

Avatarify - Cria um avatar de vídeo-chamada com o seu rosto

Então como saber se uma mídia é real ou falsa?

Algumas dicas práticas para identificar possíveis deepfakes:

Procure por falhas visuais como:

Olhos que não piscam naturalmente

Cintilação e distorções estranhas na pele

Transição estranha nas bordas do rosto

Iluminação e sombras inconsistentes

Objetos que atravessam o rosto (ex: mãos, óculos, cabelo)

Proporção e posição assimétrica das feições

Cor da pele com aparência artificial

Resolução do rosto difere do resto da imagem

Textura da pele e detalhes como rugas e poros demais ou de menos

Áreas borradas ou pixeladas, principalmente no cabelo e pescoço

Sinais de manipulação do áudio:

Tom, cadência e sotaque inconsistentes com a pessoa real

Ruído de fundo estático

Emoção não correspondente com as microexpressões faciais

Sincronia labial fora de tempo

Pausas e respiração artificial

Cliques, estalos e cortes abruptos

Pergunte-se sobre o contexto:

Eu conheço e confio na fonte deste conteúdo?

Esta pessoa realmente faria ou falaria isso?

Este comportamento é consistente com o histórico e personalidade dela?

Que interesses seriam beneficiados se isso fosse verdade?

Encontro a mesma informação em outras fontes confiáveis?

Verifique os metadados:

A data, local e dispositivo de criação fazem sentido?

O arquivo foi editado ou redimensionado?

Tem camadas ou objetos suspeitos?

Passe por um detector de IA:

Sensity (ex-Deeptrace) - Retorna a probabilidade de um vídeo ser deepfake

Mesonet e FaceForensic - Datasets para treinar seus próprios detectores

Assemblyai API - Detecta manipulação de áudio e clonagem de voz

Ferramentas gratuitas

Spot the Troll - Quiz do Facebook para conscientizar sobre deepfakes

Amber Video - Plug-in gratuito que sinaliza conteúdo potencialmente enganoso

Reality Defender - Navegador com IA embutida de detecção de fake news e imagens geradas por IA

Vale reforçar que nenhum desses métodos é 100% confiável, especialmente com o avanço contínuo da tecnologia. A melhor defesa é uma combinação de educação, pensamento crítico e verificação por múltiplas fontes e ferramentas.

O Impacto na Sociedade e nos Negócios

Sendo realistas, provavelmente nunca seremos capazes de detectar e rotular todos os deepfakes na internet. Eles se tornarão parte do nosso dia-a-dia assim como photoshop, filtros do Instagram e corretor automático.

A tendência é que a distinção entre real e falso fique cada vez mais nebulosa. O que tem implicações profundas na confiança, verdade, privacidade, segurança e no próprio tecido social.

Para cidadãos comuns, o medo de ter sua imagem roubada e usada em contextos falsos ou abusivos pode gerar ansiedade, paranóia e isolamento digital. Ao mesmo tempo, a incapacidade de discernir fato de ficção deixa as pessoas mais suscetíveis a teorias conspiratórias, tribalismo político e fanatismo.

Para figuras públicas como artistas, atletas, políticos e executivos, a ameaça é ainda maior. Deepfakes podem arruinar carreiras, relacionamentos e até render processos jurídicos. Famosos terão que monitorar ativamente sua imagem online e emitir negações públicas frequentes. Alguns já estão registrando seus "direitos digitais de imagem" e contratando serviços de proteção.

Exemplos de empresas que prestam serviço de proteção de imagem virtual

Cybersphere: oferece uma gama completa de serviços de proteção de imagem online para indivíduos e empresas, incluindo monitoramento de reputação, remoção de conteúdo, gerenciamento de crises e proteção contra deepfakes.

Six Degrees: se especializa em proteger a reputação online de executivos e profissionais. Seus serviços incluem monitoramento de mídia social, gerenciamento de resultados de pesquisa e treinamento em gerenciamento de reputação.

BrandYourself: fornece ferramentas para indivíduos e empresas removerem conteúdo negativo online e criarem uma presença online positiva. Seus serviços incluem monitoramento de reputação, remoção de conteúdo e gerenciamento de resultados de pesquisa.

ReputationManagement: oferece serviços de gerenciamento de reputação online para empresas e indivíduos. Seus serviços incluem monitoramento de mídia social, remoção de conteúdo, gerenciamento de crises e treinamento em gerenciamento de reputação.

Entrust: fornece serviços de proteção de identidade e gerenciamento de risco para empresas e indivíduos. Seus serviços incluem monitoramento de identidade, proteção contra fraude e gerenciamento de acesso.

Para as instituições democráticas, deepfakes significam uma era de desinformação constante, desconfiança nas autoridades, vulnerabilidade a interferências externas e até uma "realidade sintética" onde cada um acredita na sua própria verdade. Governos precisarão trabalhar junto com plataformas, acadêmicos e cidadãos para determinar parâmetros de autenticação de mídia, liberdade de expressão e remoção de conteúdo falso.

Para empresas e marcas, deepfakes trazem um novo nível de riscos de imagem, junto com oportunidades fascinantes de marketing e experiência do cliente. Alguns exemplos dos dois lados:

Riscos dos Deepfakes

Deepfakes de executivos anunciando falência, demissão em massa ou opinião polêmica, derrubando o preço das ações

Vídeos falsos de defeitos grosseiros ou efeitos colaterais perigosos em produtos, espalhando pânico e processos

"Testemunhos" fraudulentos de clientes e influencers sabotando competidores

Ex-funcionários criando avatares falsos da empresa para vazar dados e chantagear

Exploração de imagens de funcionários e clientes para pornografia de vingança

Oportunidades dos Deepfakes

Recriação de fundadores e mascotes icônicos para campanhas de branding e experiências interativas com a marca

Modelos virtuais proprietários para provar roupas, maquiagem, óculos, jóias de forma totalmente personalizada

Porta-vozes e vendedores virtuais treinados nos produtos e capazes de atender em qualquer idioma 24/7

Influencers virtuais 100% alinhados com o posicionamento e valores da marca sem risco de polêmicas e pedidos exorbitantes

Avatares emocionalmente inteligentes para SAC, suporte técnico e vendas com aparência e voz adaptada para cada cliente

Entrega de produtos digitais (cursos, videogames, etc) totalmente personalizados para o gosto e estilo do comprador

O Futuro dos Deepfakes

Tudo indica que estamos só arranhando a superfície do que os deepfakes serão capazes. No ritmo atual, em poucos anos a IA será capaz de gerar vídeos, fotos e áudios perfeitamente realistas de qualquer pessoa, em qualquer cenário, em tempo real e a partir de pouquíssimos dados.

Imagine as seguintes possibilidades se tornando comuns:

Filmes e jogos que adaptam os personagens e a história para incluir seu rosto, voz e reações

Assistentes pessoais IA com aparência e jeito de falar dos seus personagens favoritos

Roupas virtuais indistinguíveis das físicas para comprar, usar e revender como NFTs

IA treinada no seu histórico de navegação e GPS para recriar digitalmente locais e pessoas especiais para você

Terapia com avatares falecidos que conversam com suas memórias e fotos do Facebook

Serviços para encomendar doppelgangers virtuais para diversão ou fins mais nefastos

Apps de namoro com perfis falsos ultrarrealistas controlados por IA para interagir e trocar nudes

Campanhas do varejo simulando uma mega liquidação com vídeos deepfake de multidões enfurecidas

Ao mesmo tempo, as IAs geradoras estão ficando mais eficientes, generalistas e criativas. Isso significa produzir deepfakes de alta qualidade com muito menos dados de treinamento, misturando estilos e características diferentes.

Em vez de precisar de milhares de fotos da mesma pessoa, será possível "construir" personas totalmente digitais definindo atributos como idade, gênero, etnia, cabelo, roupa, voz e personalidade. Ou até "ressuscitar" pessoas com base no seu histórico digital.

E com a explosão de modelos de IA generativas como DALL-E, Midjourney, Stable Diffusion, ChatGPT e Whisper, teremos em breve a geração one-click não apenas de deepfakes, mas de mundos 3D completos, roteiros, efeitos especiais e dublagens a partir de comandos de texto ou voz simples. Talvez ai o metaverso passe a realmente trazer alguma relevância para a vida prática.

Isso democratizará a criação, mas também a falsificação audiovisual. Qualquer pessoa poderá diretar seu próprio filme de super-heróis no celular, mas também difamar alguém com alguns prompts.

Algumas medidas que podem ajudar a mitigar os riscos:

Ensinar pensamento crítico e checagem de fatos desde a infância

Desenvolver tecnologia para autenticar e rastrear a origem de mídias digitais (ex: blockchain)

Atualizar leis para lidar com deepfakes, difamação digital, direitos de imagem e definir responsabilidades das plataformas

Colaboração entre governos, empresas e sociedade civil para definir padrões, ferramentas abertas e boas práticas

Incentivar usos positivos e criativos dos deepfakes que gerem valor real para as pessoas

Empoderar indivíduos para controlar seus dados biométricos e treinar suas próprias IAs protetoras

O novo método Microsoft VASA-1

Um novo método chamado VASA-1 (Lifelike Audio-Driven Talking Faces Generated in Real Time) para gerar vídeos realistas de rostos falantes a partir de uma única imagem e um clipe de áudio, em tempo real.

Os principais pontos são impressionantes:

O VASA-1 é capaz de produzir movimentos labiais sincronizados com o áudio, além de capturar uma grande variedade de nuances faciais e movimentos naturais da cabeça que contribuem para a percepção de autenticidade.

As inovações centrais incluem um modelo de difusão para gerar a dinâmica holística do rosto e movimento da cabeça, que funciona em um espaço latente facial, e o desenvolvimento desse espaço latente expressivo e desembaraçado usando vídeos.

Através de experimentos extensivos, o método superou significativamente métodos anteriores em várias dimensões, gerando vídeos de alta qualidade com dinâmica realista do rosto e cabeça.

O método permite a geração online de vídeos de 512x512 a até 40 FPS com latência inicial desprezível.

Isso abre caminho para interações em tempo real com avatares que emulam comportamentos humanos de conversação.

Em resumo, o VASA-1 representa um avanço significativo na geração de rostos falantes realistas conduzidos por áudio, com aplicações promissoras em várias áreas.

Veja alguns exemplos de aplicação abaixo:

Como Empresas e Pessoas Podem se Proteger

Não existe solução mágica contra deepfakes, mas há passos práticos que organizações e indivíduos podem tomar para mitigar os riscos:

Para Empresas:

Treinar funcionários para identificar tentativas de engenharia social e solicitações suspeitas, mesmo vindo aparentemente de pessoas conhecidas

Adotar autenticação multi-fator (MFA) para todas as contas e sistemas críticos

Ter canais oficiais claramente definidos e seguro para comunicação interna e externa

Criar uma base com imagens, vídeos e áudios reais dos seus executivos e portavozes que possa ser usada para treinar detectores

Monitorar menções à marca, produtos, executivos em redes sociais, fóruns e na deep web com ferramentas automatizadas

Integrar detecção de deepfake, verificação biométrica, anti-fraude e KYC (Know Your Customer) aos produtos e aplicativos

Ter uma estratégia e um time treinado para responder rapidamente a um ataque de deepfake com transparência e dados

Colaborar com parceiros, academia e até concorrentes para compartilhar ameaças e boas práticas

Para indivíduos:

Evitar compartilhar fotos e vídeos íntimos ou constrangedores, mesmo em apps privados e para pessoas de confiança

Checar a fonte, data, local e contexto antes de acreditar em um conteúdo sensacionalista, principalmente envolvendo figuras públicas

Usar autenticação em dois fatores, senha forte e única em todas as contas online

Configurar alertas do Google e redes sociais para o seu nome, assim como serviços de proteção de identidade

Aprender a reconhecer sinais de manipulação digital em áudio e vídeo

Apoiar e cobrar legislações que responsabilizem criminosos e plataformas pela disseminação de deepfakes maliciosos

Priorizar interações ao vivo ou por vídeo com pessoas próximas para confirmar identidade e intenção em comunicações sensíveis

Ter senso de humor para lidar com sátiras, memes e zoeiras inofensivas com seu rosto :)

Enfim...

Não há volta atrás. Os deepfakes vieram para ficar e se tornarão parte integral das nossas vidas e da economia criativa. Como toda tecnologia exponencial, carregam perigos e maravilhas na mesma proporção.

Governos, empresas, instituições de pesquisa, mídia e sociedade precisam colaborar para definir limites éticos, regras e padrões que permitam aproveitar ao máximo os benefícios dos deepfakes e sistemas geradores, minimizando os riscos e efeitos colaterais.

Mas no fim, não existe substituto para o pensamento crítico, o discernimento humano e a boa e velha conversa olho-no-olho. Mais do que nunca, precisamos valorizar relacionamentos reais, empatia e propósito compartilhado.

Talvez a ascenção dos deepfakes seja um chamado para olharmos para dentro e descobrir o que realmente nos move e conecta além das imagens. A sociedade que queremos não será definida pelos deepfakes que criamos, mas pelo que fazemos para tornar a realidade melhor do que qualquer falsificação.

Você está pronto para esse desafio?